AI Deployment: Wie lässt sich AI am besten betreiben?

Diese Frage stellen sich aktuell viele Unternehmen. Denn für den Erfolg von AI ist das Deployment entscheidend. Nur wer die Überführung von Large Language Modellen (kurz: LLMs) und generative AI von der Pilotphase in den produktiven Betrieb meistert, kann tatsächlich von AI profitieren. Dabei kann das Deployment ganz unterschiedliche Dimensionen annehmen. Von kleinen Testszenarien bis hin zu großflächigen Rollouts. Doch welche Deployment-Möglichkeiten gibt es? Und wie können Unternehmen die Methode auswählen, die ihre Anforderungen am besten erfüllen? Diese und weitere Fragen beantwortet CANCOM-Expertin Eva Dölle im Gastbeitrag.

10. Februar 2026

|

Lesedauer: ca. 8 Min.

Bild: © M.Gierczyk/stock.adobe.com

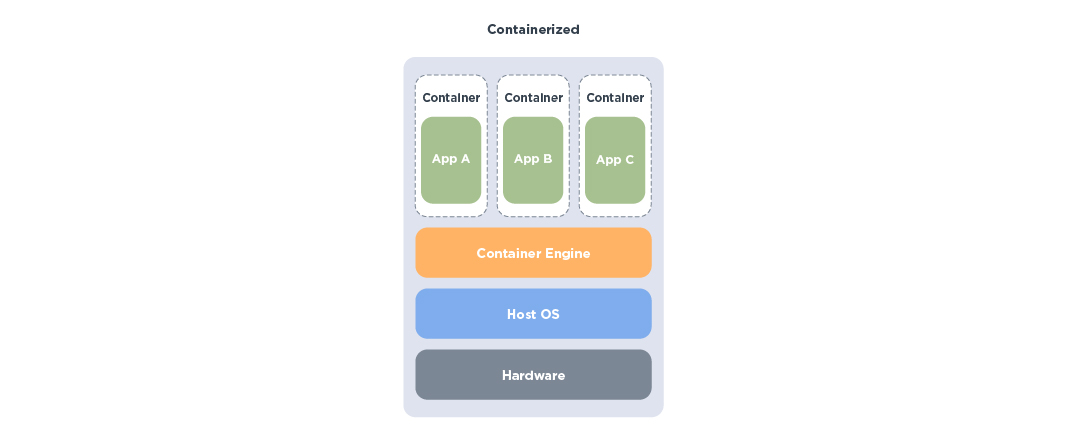

3. Containerisiertes Deployment

Beim containerisierten Deployment erfolgt die Bereitstellung über sogenannte Container. Container sind isolierte Laufzeitumgebungen, die Anwendungen abbilden. Entsprechend sind dort alle Abhängigkeiten, Bibliotheken und Konfigurationen verpackt, die benötigt werden, um diese Anwendung ausführen zu können. Im Vergleich zu VMs, teilen sich Container das Betriebssystem des Hosts.

Die Container Engine läuft auf dem Betriebssystem des Hosts und verwaltet die Container direkt (Bild: © CANCOM).

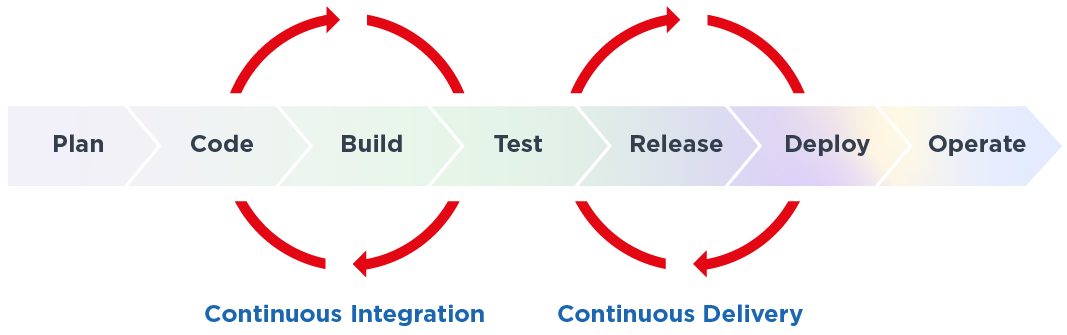

Containerisiertes Deployment ist de facto der Goldstandard für den produktiven Betrieb von AI-Modellen. Beim containerisierten Deployment teilen sich die Anwendungen den Kernel des Host-Betriebssystems, bleiben aber in ihren Laufzeitumgebungen strikt isoliert. Da Container keinen eigenen Hypervisor-Overhead haben, können sie GPU-Ressourcen sehr effizient und flexibel nutzen. Üblicherweise wird diese Technologie in CI/CD-Pipelines und MLOps-Prozessen genutzt. Hierbei durchlaufen AI-Modelle automatisierte Teststrecken und werden anschließend als Microservices bereitgestellt.

Diese Microservices können innerhalb von Sekunden vervielfacht, aber auch wieder reduziert werden (Auto-Scaling). Weiterhin werden Container auch für Entwicklung und Testing genutzt. Sie stellen sicher, dass der Code auf dem Laptop des Entwicklers exakt genauso läuft wie später im Rechenzentrum.

CI/CD-Pipelines beschreiben den kontinuierlichen Prozess von der Entwicklung (z. B. Model Training) über automatisierte Tests bis zur Bereitstellung (Deployment) von AI-Anwendungen im produktiven Betrieb (Bild: © CANCOM).

Die Bereitstellung von AI in Containern punktet vor allem wegen der sogenannten „Portabilität“. Das heißt, die Container können überall betrieben werden (lokal, hybrid, Cloud), egal, welche Hardware darunterliegt. Außerdem werden deutlich weniger Ressourcen als mit einem beteiligten Hypervisor verbraucht. Auch in puncto Schnelligkeit sind Container eine gute Wahl. Sie ermöglichen eine schnelle und automatisierte Bereitstellung über CI/CD-Pipelines und lassen sich deutlich schneller als virtuelle Maschinen starten und stoppen. Sie sind mit einem einzigen Befehl lauffähig, was das Projekt-Onboarding vereinfacht und Entwicklungszyklen verkürzt. Schließlich müssen sich Entwickler nur noch auf den Code konzentrieren und nicht auf die Umgebung selbst. Mittels Orchestrierungswerkzeugen wie Kubernetes lassen sich Container einfach verwalten und skalieren.

Containerisiertes Deployment bringt jedoch auch Komplexität mit sich. Es müssen regelmäßig Updates und Sicherheitspatches für die Container-Plattform eingespielt, die Cluster-Gesundheit überwacht sowie Netzwerkrichtlinien und Zugriffskontrollen gemanaged werden. Experten müssen zudem sicherstellen, dass die Ressourcen (CPU, RAM, Storage) effizient auf die Knoten verteilt und Backups gepflegt werden.

Auch die Isolation der Container-Umgebungen ist weniger strikt ausgeprägt als bei virtuellen Maschinen. Da sich Container den Kernel des Host-Systems teilen, fehlen die harten Sicherheitsgrenzen einer vollständigen Hardware-Virtualisierung. Bei kritischen Sicherheitsanforderungen kann dies ein Risiko darstellen. Zudem sind Container stärker an das Host-Betriebssystem gebunden. Da sie keinen eigenen Kernel mitbringen, sondern den des Hosts nutzen, können beispielsweise Linux-Container nicht ohne Weiteres auf einem Windows-Server ausgeführt werden. Bei VMs hingegen ist das kein Problem: Sie bringen ihr eigenes Betriebssystem mit.

Wann wird welches Deployment genutzt?

Zusammenfassend lässt sich sagen, dass es keine „beste“ Deployment-Methode gibt, sondern nur die passende Lösung für das jeweilige Anforderungsprofil.

Für erste Schritte und kleine, klar begrenzte AI-Anwendungsfälle, eignet sich ein Bare-Metal-Deployment auf einem einzelnen Server oder einer Workstation. Hier bleibt die Umgebung überschaubar und Änderungen können schnell umgesetzt werden. Solange nur ein oder wenige AI-Modelle im Einsatz sind, bleibt der operative Aufwand gering.

Nun könnten virtualisierte Deployments als Zwischenschritt zwischen Bare Metal und Containerisierung interpretiert werden. Dies ist jedoch nicht der Fall. Virtualisierte Deployments sind eine eigenständige Variante für klar umrissene Anwendungsfälle. Sie sind der Standard für VDI-Umgebungen und Szenarien, in denen Teams sich GPU-Ressourcen teilen müssen. Beispiele hierfür sind Architekten- oder Ingenieurbüros, die mit CAD- und 3D-Anwendungen arbeiten.

Wenn AI-Services von vielen Anwendungen genutzt werden und mehrere AI-Modelle parallel laufen sollen, ist ein containerisiertes Deployment die beste Wahl. Containerisierte Inferenzserver verpacken AI-Modell und Abhängigkeiten in Containern, liefern standardisierte APIs und lassen sich zentral betreiben. Mit Kubernetes können diese Services automatisiert ausgerollt, überwacht und bei Bedarf hoch- oder herunterskaliert werden. Wer also einen großflächigen Rollout von AI-Modellen plant, sollte auf das containerisierte Deployment setzen.

Egal, für welches Deployment sich Unternehmen entscheiden: Eine professionelle Kubernetes-Plattform ist in vielen Fällen die solide Basis. Denn damit lässt sich das Vorhaben nachhaltig und langfristig umsetzen. Alternativ sollte zumindest eine vergleichbar verwaltbare Container-Plattform eingeführt werden.

Fazit

Der Bereich AI Deployment ist für Unternehmen unabdingbar. Durch die richtige Umsetzung können AI-Projekte von der Pilotphase erfolgreich in den produktiven Betrieb überführt werden und somit den gewünschten Mehrwert schaffen.

Die Umsetzung ist jedoch komplex. Firmen müssen entscheiden, welche Umgebungen (On Premise, Cloud, hybrid, Edge) und Methoden (Bare Metal, Virtualisierung, Containerisierung) sie für das Deployment nutzen möchten.

Wir von CANCOM unterstützen Ihr Unternehmen umfassend bei dieser Entscheidung: Gemeinsam mit Ihnen beleuchten wir Ihre individuellen Anforderungen und entwerfen daraufhin die passende Implementierung. Bei Bedarf kümmern wir uns außerdem um die Einführung entsprechender Lösungen in Ihren Betrieb. Hier können Sie mit unseren Experten in Kontakt treten.